AI 비용은 GPU만 고려하지 마세요, 메모리 관리가 새로운 승부처다

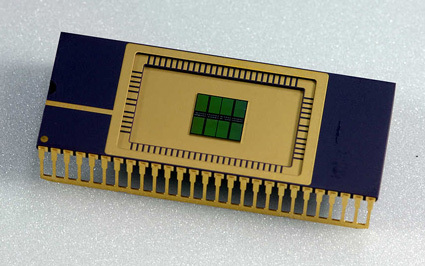

도입부: AI 인프라 비용을 생각할 때, 대부분은 NVIDIA GPU를 떠올립니다. 하지만 DRAM 칩 가격이 1년 만에 약 7배 오른 것을 보니, 이제 메모리 관리가 더 중요해졌어요. 특히 클라우드 기업들은 데이터 센터를 투자하면서 메모리를 잘 조율하는 데 집중하고 있어요.

무슨 일이 일어났나

Anthropic의 프롬프트 캐싱 문서가 급격히 복잡해졌다는 사실을 보니, 메모리 관리가 AI에서 얼마나 중요한지 알 수 있어요. 6-7개월 전에는 "캐시 사용하면 비용 절감" 정도의 간단한 페이지였지만, 지금은 캐시 작성 횟수를 미리 구매하는 방법까지 설명하는 'encyclopedia'가 됐어요. 5분 단위나 1시간 단위의 캐싱 시간을 선택할 수 있고, 캐시에 있는 데이터를 사용하면 비용이 훨씬 저렴해져요. 하지만 새로운 데이터가 추가되면 기존 데이터가 캐시에서 나가는 것도 고려해야 하는 복잡한 부분이 있어요.

TensorMesh라는 스타트업은 이 문제를 해결하기 위해 캐시 최적화 기술을 개발하고 있어요. 메모리 관리를 잘하는 회사가 성공할 것이라는 분석도 있습니다. 또한, 서버 비용이 낮아지면 현재 수익성 없던 애플리케이션들이 유망해질 가능성도 있다고 합니다.

내가 보기엔

메모리 관리가 AI의 새로운 승부처라니, 정말 흥미롭네요. 작은 기업이라도 메모리를 효율적으로 사용하면 비용을 절감할 수 있겠지만, 복잡한 캐시 시스템을 구축하는 데는 많은 노력이 필요할 것 같아요. 특히 DRAM 가격 상승으로 인해 더 큰 투자가 필요하겠죠. 하지만 이 기술이 발전한다면, 사용자들은 더 저렴한 AI 서비스를 받을 수 있을 거예요. 지금은 GPU만 고려하지 말고, 메모리 관리 능력도 함께 확인해야 할 것 같아요.